Tags

- 2d

- 3D

- 3D Software

- 3ds max

- Anfänger

- Animation

- bake

- Blender

- blu-ray

- Blueprints

- c4d

- character

- Cinema4d

- copyright

- Design

- DGM

- DVD ripper

- DVDFab

- echten Führerschein

- einstellung

- extrudieren

- Farbe

- Freelance

- gamma

- Glas

- high quality replica

- hilfe

- Job

- Map

- Mapping

- Material

- maya

- Modeling

- Modelling

- modifier

- modo

- Passkey

- Photogrammetrie

- Photoshop

- poly

- Praktikum

- problem

- Programm

- Programme

- RAM

- Reisepass

- rendering

- Seams

- shader

- Software

- swiss Mechanical mov

- Textur

- texturen

- Tutorial

- uv

- VFX

- Visum kaufen

- vray

- WebGL

- Zukunft

UV-Mapping (richtig verstehen)

25.03.2021 13:45

SleepyDi. 30 Mär. 2021, 12:28 Uhr

Sorry, habe dich in Bezug auf Registrierung mit einem anderen User hier verwechselt.

Wusste seinen Namen nicht mehr und da du was von Registrierung geredet hast, dachte ich du wärst dieser User hier, der mir ein UV-Mapping Program geraten hat, wo aber auf der Webseite weder Preise noch eine Demo-Version sichtbar waren.

Und nur eine Registrierung sichtbar war.

DU musst schon lesen wer hier was schreibt und auf wen du wie antwortest. Das ist genau das was hier immer solches Chaos verursacht.

Realtime Renderer sind nicht fürs Baken gedacht ich hoffe das ist dir bewusst. Für Keyshort brauchst du auch keine UVs

Es gibt auch kostenlose Programme wie Xnormals mit denen du deine Maps baken kannst, komplett ohne Registrierung

https://www.youtube.com/watch?v=e8M4wrCBcDE

Ich hab den Eindruck du verwechselt hier schon wieder UV- Mapping, Texturen, Baken und Echtzeit Renderer

Kennst du eigentlich Google ?

https://www.substance3d.com/download/

VisionOfVictorDi. 30 Mär. 2021, 12:34 Uhr

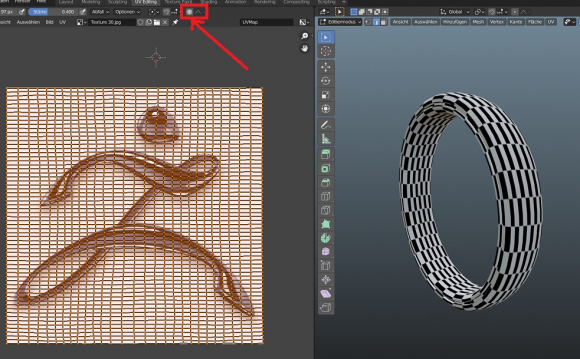

Jo, ist fast perfekt.

Aber so perfekt auch wieder nicht.

Schaut man genaustens, genaustens hin, merkt man, dass man zumind. ausbessern muss.

Und dann wird es Fummelarbeit.

Dann nutze ich gerne auch die Brush-Werkzeuge oben.

UND: Ich habe gemerkt, wenn ich ein anderes, eher neutrales (kein Muster) Bild rauflade und es mit dem vorherigen, gekachelte einfach austausche, bleibt das vorherige (gekachelte) Muster ironischerweise auf dem Model im 3D Feld, aber das neue wird nur im UV-Feld geladen.

Komisch. Wieso ist das so? Weil bereits umgewrappt wurde? Und somit das Bild nicht nachaktualisiert werden kann im 3D Feld?

Irgendwie doch gut. So sehen ich mit einem cleaneren Bild ( zb. ganz weiss), die Mesh im UV-Feld besser, wenn ich es nachkorrigieren will. Da mehr Kontrast damit zur Mesh.

So, jetzt muss ich aber Kochen gehen. Muss ja auch was essen. Nicht wie die Suchtis, die nie was essen, weil sie nicht vom PC kommen.

*lol Was sein muss, muss sein.

Danke für eure Mühen. Hab wieder Freude. Ja,...ab zum nächsten Patch. Juhuu...

Aber so perfekt auch wieder nicht.

Schaut man genaustens, genaustens hin, merkt man, dass man zumind. ausbessern muss.

Und dann wird es Fummelarbeit.

Dann nutze ich gerne auch die Brush-Werkzeuge oben.

UND: Ich habe gemerkt, wenn ich ein anderes, eher neutrales (kein Muster) Bild rauflade und es mit dem vorherigen, gekachelte einfach austausche, bleibt das vorherige (gekachelte) Muster ironischerweise auf dem Model im 3D Feld, aber das neue wird nur im UV-Feld geladen.

Komisch. Wieso ist das so? Weil bereits umgewrappt wurde? Und somit das Bild nicht nachaktualisiert werden kann im 3D Feld?

Irgendwie doch gut. So sehen ich mit einem cleaneren Bild ( zb. ganz weiss), die Mesh im UV-Feld besser, wenn ich es nachkorrigieren will. Da mehr Kontrast damit zur Mesh.

So, jetzt muss ich aber Kochen gehen. Muss ja auch was essen. Nicht wie die Suchtis, die nie was essen, weil sie nicht vom PC kommen.

*lol Was sein muss, muss sein.

Danke für eure Mühen. Hab wieder Freude. Ja,...ab zum nächsten Patch. Juhuu...

VisionOfVictorDi. 30 Mär. 2021, 12:36 Uhr

Sorry, habe dich in Bezug auf Registrierung mit einem anderen User hier verwechselt.

Wusste seinen Namen nicht mehr und da du was von Registrierung geredet hast, dachte ich du wärst dieser User hier, der mir ein UV-Mapping Program geraten hat, wo aber auf der Webseite weder Preise noch eine Demo-Version sichtbar waren.

Und nur eine Registrierung sichtbar war.

DU musst schon lesen wer hier was schreibt und auf wen du wie antwortest. Das ist genau das was hier immer solches Chaos verursacht.

Realtime Renderer sind nicht fürs Baken gedacht ich hoffe das ist dir bewusst. Für Keyshort brauchst du auch keine UVs

Es gibt auch kostenlose Programme wie Xnormals mit denen du deine Maps baken kannst, komplett ohne Registrierung

https://www.youtube.com/watch?v=e8M4wrCBcDE

Ich hab den Eindruck du verwechselt hier schon wieder UV- Mapping, Texturen, Baken und Echtzeit Renderer

Okey, danke für das Video.

Schaue ich mir mal an.

Ja, ist halt alles Neuland, mehr oder weniger.

Bisher habe ich nur ZBrush in seinen Fuktionen tiefer gelernt, in Bezug auf Sculpting und Modeling. War schon mehr als Genug Zeitopferung. Und jetzt kommt das alles auch noch. Ufff* Aber so lange es Spass macht und ich es irgendwie zurecht biege,...wird schon werden. Thx.

MOD

TilesDi. 30 Mär. 2021, 12:45 Uhr

Texturen musst du im Material zuweisen. Das geht nicht vom UV Editor aus. Da kannst du nur sowas wie ein Vorschaubild laden. Und eben diese Checkertextur fürs mappen.

Also erst mal im Shader Editor ein Material anlegen, dann eine Texture Node anstöpseln. Und in der dann die Textur laden.

Also erst mal im Shader Editor ein Material anlegen, dann eine Texture Node anstöpseln. Und in der dann die Textur laden.

VisionOfVictorDi. 30 Mär. 2021, 14:04 Uhr

@Sleepy

Also mittlerweile weiss ich ja was UV-Wrapping ist.

Texturen sind ja einfach nur Bilder.

Und Maps sind? Eben Normal-Maps, Ambient Occlusion Maps, und ect.?

Okey.

Aber was wird denn immer gemeint, mit HighPoly auf ein Lowpoly backen?

Siehe:

https://youtu.be/0eYcYg-2YEU?t=488

Ist damit nicht gemeint, dass man die Maps (also die Detail-Informations-Maps des Models, wie zb. die Normal-Maps, die ja für die Lichter zuständig sind, wo die Lichter fallen sollen und die Bump oder und die Displacement Maps, die auch den 3D Effekt sozusgangen der Tiefe dem Model geben, nicht auf ein Lowpoly BACKT, damit das Lowpoly, mit seinen wenigen Polys aber wie ein Highpoly wirkt?

Und man sich dadurch das HighPoly Mesh spart, um eben dann das fertige Model zu animieren?

Damit man Performance spart?

Ich dachte immer Backen genau das.

Wobei, so wie du es sagst, ist Backen zugleich auch demfall diese Dateien (Normal Map, Bump Map, ect.) sozusagen im Programm zu "drucken"/erstellen (symbolisch gesprochen), um sie dann eben zu exportieren.

Also nennt man backen zwei Prozesse:

- Einmal (um mit dem zweiten Prozess anzufangen) die Maps zu erstellen im Program selbst und zu exportieren. Ala: "Sie sind im Programm nun gebacken worden."

Und.

- Als zweiter Prozess: Sie (die Maps) dann eben in einem anderen Program nur dem LowPoly Model dort drüber zu backen, damit man sich sozusagen das Highpoly Model spart, fürs Rendern oder auch animieren. Damit man Performance und Dateilast des Highpolys sich spart (und das Highpoly somit nicht braucht).

Also eine Illusion eigentlich des Highpoly damit erreicht, mit den Maps drüber backen über das Lowpoly.

Ich dachte immer dass Backen das in etwa sein. Vorallem der Prozess zwei.

Die HighPoly Meshes, wären also sozusagen nur dafür da, das Model erst mal einfach zu erschaffen um die Maps in ihren Detailiformationen überhaupt "drucken"/erstellen und exportieren zu können, später für das LowPoly Model (und darüber eben dann zu backen, in einem anderen Program).

Wenn du wissen willst, wieso mich das alles so verwirrt hat, ist es folgender Massen:

- A.) Für Maps braucht man UV (gleichzeitig nennen die Leute auch das Wort UV-Maps. Was ich früher mit UV-Wrapping in Verbindung gebracht habe. Was ja wo stimmt. Nur sind UV-Maps nicht das UV-Wrapping selbst. Es sind einfach die Maps die eben diese Informationen beeinhalten, die überhaupt zustande kommen können, weil die Mesh eine UV dann hat (umwrappt wurde.)

- B.) Wiederum, brauchst du für eine vernünftige Textur drüber legen, auch wieder UV (umwrapping).

Also musst du die Mesh umwrappen. Wo ich wieder Mühe hatte (hatte!) zwischen Texturen und Maps zu unterscheiden. Was ich jetzt aber mittlerweile weiss.

Nur (und jetzt kommt das Hardcoree), ist ironischerweise Painting am Model ja schlussendlich auch nur eine Textur (eine selbstaufgemalte Textur halt). Gleichzeitig gibt es aber die Color-ID Map, die man ja auch exportiert. Also ist dein gemaltes keine Textur, sondern eine Map. Also zählt das gepaintete zu den Maps? Wenn ich es richtig also verstehe?

- C.) Und genau da gipfelte das ganze im Chaos:

Denn all das ist miteinander verbunden:

Eine Mesh besitzt eine UV = UV-Umwrapping, Texturen, Painting, Maps (Normal Maps, ect. ect.) und das backen in ein Lowpoly (siehe Video link).

Und dann kam jetzt noch das Rendering dazu (Real-Time Render vs ZBrush Render), und importieren der Normal Maps und Co. (weil ich in einem KeyShot Tutorial gesehen habe wie er die Normal Map importierte)......also fürs Rendern? Oder eben fürs Backen in das Lowpoly?

Also braucht das Rendern doch die Maps. Und weil das Lowpoly die Maps braucht, braucht auch das Rendern die Maps. Ohne geht ja das Rendern der detailierten Erscheinung nicht. Also braucht der Render auch die Maps.

Daher dachte ich, nur Real-Time Renderer brauchen die Maps.

Aber eigentlich geht es nur darum, dass die LowPoly Mesh die Maps braucht. Stimmts?

Um das gehts. Der Render ansich ja nicht. Als Renderer. Er rendert ja einfach was da ist.

Also schlimmer geht es nicht an Informationsfluut.

*lach

Aber zurück zur Frage:

Ist baken also diese zwei Prozesse; Liess nochmals oben?

Maps auf LowPolymodel, damit das Lowpoly Model optisch wie ein Highpoly wirkt und man sich so rechnenprozesse bei der animation oder rendering spart.

@Tiles

Okey,...denke das habe ich verstanden.

Demfall ist die Textur im UV Editor nur eine Checkertextur (Vorschaubild).

Und im 3D Feld dem Model (also dem Material am Mesh eine Textur geben) die echte Textur geben.

Realtime Renderer sind nicht fürs Baken gedacht ich hoffe das ist dir bewusst. Für Keyshort brauchst du auch keine UVs

Es gibt auch kostenlose Programme wie Xnormals mit denen du deine Maps baken kannst, komplett ohne Registrierung

...

Ich hab den Eindruck du verwechselt hier schon wieder UV- Mapping, Texturen, Baken und Echtzeit Renderer

....

Also mittlerweile weiss ich ja was UV-Wrapping ist.

Texturen sind ja einfach nur Bilder.

Und Maps sind? Eben Normal-Maps, Ambient Occlusion Maps, und ect.?

Okey.

Aber was wird denn immer gemeint, mit HighPoly auf ein Lowpoly backen?

Siehe:

https://youtu.be/0eYcYg-2YEU?t=488

Ist damit nicht gemeint, dass man die Maps (also die Detail-Informations-Maps des Models, wie zb. die Normal-Maps, die ja für die Lichter zuständig sind, wo die Lichter fallen sollen und die Bump oder und die Displacement Maps, die auch den 3D Effekt sozusgangen der Tiefe dem Model geben, nicht auf ein Lowpoly BACKT, damit das Lowpoly, mit seinen wenigen Polys aber wie ein Highpoly wirkt?

Und man sich dadurch das HighPoly Mesh spart, um eben dann das fertige Model zu animieren?

Damit man Performance spart?

Ich dachte immer Backen genau das.

Wobei, so wie du es sagst, ist Backen zugleich auch demfall diese Dateien (Normal Map, Bump Map, ect.) sozusagen im Programm zu "drucken"/erstellen (symbolisch gesprochen), um sie dann eben zu exportieren.

Also nennt man backen zwei Prozesse:

- Einmal (um mit dem zweiten Prozess anzufangen) die Maps zu erstellen im Program selbst und zu exportieren. Ala: "Sie sind im Programm nun gebacken worden."

Und.

- Als zweiter Prozess: Sie (die Maps) dann eben in einem anderen Program nur dem LowPoly Model dort drüber zu backen, damit man sich sozusagen das Highpoly Model spart, fürs Rendern oder auch animieren. Damit man Performance und Dateilast des Highpolys sich spart (und das Highpoly somit nicht braucht).

Also eine Illusion eigentlich des Highpoly damit erreicht, mit den Maps drüber backen über das Lowpoly.

Ich dachte immer dass Backen das in etwa sein. Vorallem der Prozess zwei.

Die HighPoly Meshes, wären also sozusagen nur dafür da, das Model erst mal einfach zu erschaffen um die Maps in ihren Detailiformationen überhaupt "drucken"/erstellen und exportieren zu können, später für das LowPoly Model (und darüber eben dann zu backen, in einem anderen Program).

Wenn du wissen willst, wieso mich das alles so verwirrt hat, ist es folgender Massen:

- A.) Für Maps braucht man UV (gleichzeitig nennen die Leute auch das Wort UV-Maps. Was ich früher mit UV-Wrapping in Verbindung gebracht habe. Was ja wo stimmt. Nur sind UV-Maps nicht das UV-Wrapping selbst. Es sind einfach die Maps die eben diese Informationen beeinhalten, die überhaupt zustande kommen können, weil die Mesh eine UV dann hat (umwrappt wurde.)

- B.) Wiederum, brauchst du für eine vernünftige Textur drüber legen, auch wieder UV (umwrapping).

Also musst du die Mesh umwrappen. Wo ich wieder Mühe hatte (hatte!) zwischen Texturen und Maps zu unterscheiden. Was ich jetzt aber mittlerweile weiss.

Nur (und jetzt kommt das Hardcoree), ist ironischerweise Painting am Model ja schlussendlich auch nur eine Textur (eine selbstaufgemalte Textur halt). Gleichzeitig gibt es aber die Color-ID Map, die man ja auch exportiert. Also ist dein gemaltes keine Textur, sondern eine Map. Also zählt das gepaintete zu den Maps? Wenn ich es richtig also verstehe?

- C.) Und genau da gipfelte das ganze im Chaos:

Denn all das ist miteinander verbunden:

Eine Mesh besitzt eine UV = UV-Umwrapping, Texturen, Painting, Maps (Normal Maps, ect. ect.) und das backen in ein Lowpoly (siehe Video link).

Und dann kam jetzt noch das Rendering dazu (Real-Time Render vs ZBrush Render), und importieren der Normal Maps und Co. (weil ich in einem KeyShot Tutorial gesehen habe wie er die Normal Map importierte)......also fürs Rendern? Oder eben fürs Backen in das Lowpoly?

Also braucht das Rendern doch die Maps. Und weil das Lowpoly die Maps braucht, braucht auch das Rendern die Maps. Ohne geht ja das Rendern der detailierten Erscheinung nicht. Also braucht der Render auch die Maps.

Daher dachte ich, nur Real-Time Renderer brauchen die Maps.

Aber eigentlich geht es nur darum, dass die LowPoly Mesh die Maps braucht. Stimmts?

Um das gehts. Der Render ansich ja nicht. Als Renderer. Er rendert ja einfach was da ist.

Also schlimmer geht es nicht an Informationsfluut.

*lach

Aber zurück zur Frage:

Ist baken also diese zwei Prozesse; Liess nochmals oben?

Maps auf LowPolymodel, damit das Lowpoly Model optisch wie ein Highpoly wirkt und man sich so rechnenprozesse bei der animation oder rendering spart.

@Tiles

Texturen musst du im Material zuweisen. Das geht nicht vom UV Editor aus. Da kannst du nur sowas wie ein Vorschaubild laden. Und eben diese Checkertextur fürs mappen.

Also erst mal im Shader Editor ein Material anlegen, dann eine Texture Node anstöpseln. Und in der dann die Textur laden.

Okey,...denke das habe ich verstanden.

Demfall ist die Textur im UV Editor nur eine Checkertextur (Vorschaubild).

Und im 3D Feld dem Model (also dem Material am Mesh eine Textur geben) die echte Textur geben.

HoschieDi. 30 Mär. 2021, 14:54 Uhr

Sorry, habe dich in Bezug auf Registrierung mit einem anderen User hier verwechselt.

Wusste seinen Namen nicht mehr und da du was von Registrierung geredet hast, dachte ich du wärst dieser User hier, der mir ein UV-Mapping Program geraten hat, wo aber auf der Webseite weder Preise noch eine Demo-Version sichtbar waren.

Und nur eine Registrierung sichtbar war.....

Erzähl doch nicht so einen Mist ...

https://www.rizom-lab.com/

wo muss man sich hier registrieren um das abzufragen was man wissen will?

Blödes Geschwätz

geh mal unter Shop, dann Store... (im übrigen findest hier auch die Demo)

edit: zum thema auto bei jeder probefahrt musst dein führerschein zeigen, auch wenn es kein Lambo ist, nochmal ein blödes gerede von dir.

HoschieDi. 30 Mär. 2021, 14:58 Uhr

Aber was wird denn immer gemeint, mit HighPoly auf ein Lowpoly backen?

Hat auch schon jemand beantworte glaub bei Seite 5. Du schreibst selbst so viel, dass du die Antworten vergisst.

Oder vielleicht vergisst du deine eigene Frage.

Es werden die Details (Geometrie) des Highpoly-Objekts auf die diversen Maps der LowPoly gebacken,

um das möglichst gleiche Ergebnis bei weniger PolyCount zu haben, wichtig für z.B. Spieleindustrie.

edit: brauchst du ein LowPoly überhaupt? Was willst du den machen?

Denn das wäre doch jetzt die wichtige und richtige frage.

Denn alles auf einmal lernen ist großes Kino. Wenn du nur ein Bild rendern möchtest ist es im ersten Ansatz nicht nötig ein LowPoly variante zu erstellen.... auch Objekt abhängig.

Frei nach dem Motto, erstmal laufen lernen bevor man rennt

jonnydjangoDi. 30 Mär. 2021, 15:18 Uhr

Baken ist vereinfacht gesagt, die Textur zu erstellen, die dein Lowpoly wie ein Highpoly wirken lässt.

(natürlich ist das noch viel mehr, aber inzwischen ist das die gängigste Anwendung)

Die Textur dann dem Lowpoly zuzuweisen hat nichts mit baken zu tun.

Du wirst nie effektiv dazulernen, wenn du die Begriffe nicht lernst. Und wenn du schon auf deine Lokalisationen bestehst, musst du zumindest wissen wie das auch auf Englisch genannt wird. Und im Idealfall weiß man auch noch wie das in anderen Tools heißt. Dann kann man sein Wissen transferieren.

Aktuell hörst du aber nicht richtig zu. Dadurch verkomplizierst du alles.

Ein Tipp von mir, beschränke dich pro Post auf eine Frage und stelle keine 10 auf einmal. In dem Thread steckt genug Wissen um dir eine gute Basis fürs UV mappen zu bieten, du nutzt sie nur nicht.

(natürlich ist das noch viel mehr, aber inzwischen ist das die gängigste Anwendung)

Die Textur dann dem Lowpoly zuzuweisen hat nichts mit baken zu tun.

Du wirst nie effektiv dazulernen, wenn du die Begriffe nicht lernst. Und wenn du schon auf deine Lokalisationen bestehst, musst du zumindest wissen wie das auch auf Englisch genannt wird. Und im Idealfall weiß man auch noch wie das in anderen Tools heißt. Dann kann man sein Wissen transferieren.

Aktuell hörst du aber nicht richtig zu. Dadurch verkomplizierst du alles.

Ein Tipp von mir, beschränke dich pro Post auf eine Frage und stelle keine 10 auf einmal. In dem Thread steckt genug Wissen um dir eine gute Basis fürs UV mappen zu bieten, du nutzt sie nur nicht.

SleepyDi. 30 Mär. 2021, 15:37 Uhr

Was ist Baken:

EIn Würfel besteht 8 Vertecies (Punkten). Wenn du ein Würfel erstellt hast, hat jedes Vertex eine Ausrichtung. Das ist so, als wenn du nur den Punkt drehen würdest, was augenscheinlich erstmal keinen Unterschied macht.

Bei einem Würfel sind die Vertecies immer Orthogonal ausgerichtet, X Achse des Vertex zeigt in X Richtung, das Y Richtung Vertex in Y Richtung die Z Richtung zeigt exakt in Z Richtung.

Ein Vertex hat im Grunde also eine XYZ Position und eine XYZ Rotation. (Wobei die die Rotation nicht sehen kannst es sei den du lässt die die Vertex Normals anzeigen.

Die Normal zeigen im Grunde immer die in Positive richtung X+ Y+ Z+ Sind die Normals falschrum, zeigen die Normal in die - Richtung.

Gibts du der Edge eines Würfel eine Soften Smoothing Group wird die Normal Richtung der Vertecies gedreht, die an der Edge dran hängen. Die Vertecies werden dann um 45 Grad gedreht. (Damit ist das Shading dann runder=

Augenscheinlich macht das wie gesagt keinen Unterschied.(Nur für das Shading)

Dass 3D Programm weiß, da das Vertex gedreht ist muss das Licht dort anderst zurück geworfen werden. Sprich das Shading ist beim Smooth runder als bei Harden Edge die Orthogonal ausgerichtet sind.

Fügst du in Zbrush weitere Geometrie dazu, werden die Normals interpoliert sprich die Normal der Vertecies werden zischen 0 und 90 Grad ausgerichtet. Alle Ausrichtungen ergeben in der Summer aber immer maximal 90 Grad. Umso mehr Unterteilungen du einfügt umso mehr wird die Normale Ausrichtung auf alle Vertecies verteilt.

Hier siehst du einen würfel mit Harden Ausrichtung, hier sind die Normals orthogonal ausgerichtet:

http://wiki.polycount.com/w/images/e/e5/FrostSoft_doc-3.png

So sieht das aus wenn du dir die Vertex Normals anzeigen lässt:

https://upload.wikimedia.org/wikipedia/commons/3/3c/Vertex_normals.png

Sieht aus wie ein Igel wo du siehst in welche Richtung das Vertex ausgerichtet sind. Dahin wo das Vertex zeigt, nennt man Normal-Richtung.

Diese Informationen wohin welches Vertex zeigt, kann man in eine Map backen. Backen kann man viele Maps bei der Normal Map werden die Vertex Informationen in die Normal map geschrieben, das ist die blaue Map mit den grün, roten Strichen.

https://i.stack.imgur.com/nG8hp.png

Die Map ist blau weil das die Orthogonale Richtung ist. Alles was rot auf einer Normal ist, zeigt die X Richtung und alles was grün ist zeigt die Y Richtung.

Durch die Normal weiß ein 3D Programm in welche Richtung welches Vertex zeigt und somit auch in welche Richtung welche Fläche (Face zeigt)

Meistens spricht man bei der Normal nämlich von der Fläche wobei die Face Normals immer du die Vertex Normals berechnet werden.

Beim Backen wird deswegen geschaut wohin zeigt welche Vertex schaut und daraus kann das 3D Programm berechnen wohin eine Fläche (positiv) schaut. Diese Information wird in die Normal geschrieben die von anderen Programmen gelesen und interpretiert werden können. Dadurch wird die Geometrie gefaked.

Die Normalmap kann man aber nicht einfach rausspeichern, sonder die Normalmap muss von einem Programm berechnet werden. Das geht zb mit dem Substance Painter, dem Substance Designer, XNormals, Blender uvm.

Realtime Renderer wie zb Keyshot sind Renderprogramme, sie können Normals die du aber zuvor gebaken hast lesen und rendern sie.

Renderer wie Keyshot oder Marmosset sind aber nicht dafür gedacht Normals zu erstellen wobei Marmoset glaube ich auch Baken kann. Keyshot kann dass soweit ich weiß nicht.

Keyshot beispielsweise braucht keine UV Map da das Material von Keyshot selber berechnet wird. Ich kann dir auch nicht sagen wie Keyshot das macht. Der Nachteil ist aber das du die Materallien ohne UV nicht einfach aus Keyshot exportieren kennst. Dafür müsstest du die Texturen Baken und damit du baken kannst brauchst dein Mesh eine UV Map.

Dein Workflow kann so aussehen:

1. Dein Mesh in Zbrush erstellen.

2. Dein Mesh nach Keyshot exportieren Materialien drauf hauen fertig.

Mehr kannst du damit nicht anstellen.

oder:

1.Mesh in Zbrush erstellen.

2.Dein Mesh nach Blender exportieren

3.Dort eine Retopo machen

4.UV der Retopo machen

5.Deine Retopo mit UV aus Blender in X Normal importieren

6.Dein Highpoly aus Zbrush in X Normal importieren

7.die Normal Baken

8. Die Normal in Keyshot, Unity, Unreal oder wo auch immer nutzen um zu Rendern.

Mit dem einen Workflow präsentierst du dein Highpoly ganz ohne UV ohne Baken und ohne Performance zu sparen und beim anderen Workflow sparst du Performance und hast außerdem die Möglichkeit weitere Textur Effects wie beispielsweise Edge Weathering hinzuzufügen. Du hast um einiges mehr möglichkeiten.

Hier sowas zb.: https://www.youtube.com/watch?v=3sVSQ_T2dR4

EIn Würfel besteht 8 Vertecies (Punkten). Wenn du ein Würfel erstellt hast, hat jedes Vertex eine Ausrichtung. Das ist so, als wenn du nur den Punkt drehen würdest, was augenscheinlich erstmal keinen Unterschied macht.

Bei einem Würfel sind die Vertecies immer Orthogonal ausgerichtet, X Achse des Vertex zeigt in X Richtung, das Y Richtung Vertex in Y Richtung die Z Richtung zeigt exakt in Z Richtung.

Ein Vertex hat im Grunde also eine XYZ Position und eine XYZ Rotation. (Wobei die die Rotation nicht sehen kannst es sei den du lässt die die Vertex Normals anzeigen.

Die Normal zeigen im Grunde immer die in Positive richtung X+ Y+ Z+ Sind die Normals falschrum, zeigen die Normal in die - Richtung.

Gibts du der Edge eines Würfel eine Soften Smoothing Group wird die Normal Richtung der Vertecies gedreht, die an der Edge dran hängen. Die Vertecies werden dann um 45 Grad gedreht. (Damit ist das Shading dann runder=

Augenscheinlich macht das wie gesagt keinen Unterschied.(Nur für das Shading)

Dass 3D Programm weiß, da das Vertex gedreht ist muss das Licht dort anderst zurück geworfen werden. Sprich das Shading ist beim Smooth runder als bei Harden Edge die Orthogonal ausgerichtet sind.

Fügst du in Zbrush weitere Geometrie dazu, werden die Normals interpoliert sprich die Normal der Vertecies werden zischen 0 und 90 Grad ausgerichtet. Alle Ausrichtungen ergeben in der Summer aber immer maximal 90 Grad. Umso mehr Unterteilungen du einfügt umso mehr wird die Normale Ausrichtung auf alle Vertecies verteilt.

Hier siehst du einen würfel mit Harden Ausrichtung, hier sind die Normals orthogonal ausgerichtet:

http://wiki.polycount.com/w/images/e/e5/FrostSoft_doc-3.png

So sieht das aus wenn du dir die Vertex Normals anzeigen lässt:

https://upload.wikimedia.org/wikipedia/commons/3/3c/Vertex_normals.png

Sieht aus wie ein Igel wo du siehst in welche Richtung das Vertex ausgerichtet sind. Dahin wo das Vertex zeigt, nennt man Normal-Richtung.

Diese Informationen wohin welches Vertex zeigt, kann man in eine Map backen. Backen kann man viele Maps bei der Normal Map werden die Vertex Informationen in die Normal map geschrieben, das ist die blaue Map mit den grün, roten Strichen.

https://i.stack.imgur.com/nG8hp.png

Die Map ist blau weil das die Orthogonale Richtung ist. Alles was rot auf einer Normal ist, zeigt die X Richtung und alles was grün ist zeigt die Y Richtung.

Durch die Normal weiß ein 3D Programm in welche Richtung welches Vertex zeigt und somit auch in welche Richtung welche Fläche (Face zeigt)

Meistens spricht man bei der Normal nämlich von der Fläche wobei die Face Normals immer du die Vertex Normals berechnet werden.

Beim Backen wird deswegen geschaut wohin zeigt welche Vertex schaut und daraus kann das 3D Programm berechnen wohin eine Fläche (positiv) schaut. Diese Information wird in die Normal geschrieben die von anderen Programmen gelesen und interpretiert werden können. Dadurch wird die Geometrie gefaked.

Die Normalmap kann man aber nicht einfach rausspeichern, sonder die Normalmap muss von einem Programm berechnet werden. Das geht zb mit dem Substance Painter, dem Substance Designer, XNormals, Blender uvm.

Realtime Renderer wie zb Keyshot sind Renderprogramme, sie können Normals die du aber zuvor gebaken hast lesen und rendern sie.

Renderer wie Keyshot oder Marmosset sind aber nicht dafür gedacht Normals zu erstellen wobei Marmoset glaube ich auch Baken kann. Keyshot kann dass soweit ich weiß nicht.

Keyshot beispielsweise braucht keine UV Map da das Material von Keyshot selber berechnet wird. Ich kann dir auch nicht sagen wie Keyshot das macht. Der Nachteil ist aber das du die Materallien ohne UV nicht einfach aus Keyshot exportieren kennst. Dafür müsstest du die Texturen Baken und damit du baken kannst brauchst dein Mesh eine UV Map.

Dein Workflow kann so aussehen:

1. Dein Mesh in Zbrush erstellen.

2. Dein Mesh nach Keyshot exportieren Materialien drauf hauen fertig.

Mehr kannst du damit nicht anstellen.

oder:

1.Mesh in Zbrush erstellen.

2.Dein Mesh nach Blender exportieren

3.Dort eine Retopo machen

4.UV der Retopo machen

5.Deine Retopo mit UV aus Blender in X Normal importieren

6.Dein Highpoly aus Zbrush in X Normal importieren

7.die Normal Baken

8. Die Normal in Keyshot, Unity, Unreal oder wo auch immer nutzen um zu Rendern.

Mit dem einen Workflow präsentierst du dein Highpoly ganz ohne UV ohne Baken und ohne Performance zu sparen und beim anderen Workflow sparst du Performance und hast außerdem die Möglichkeit weitere Textur Effects wie beispielsweise Edge Weathering hinzuzufügen. Du hast um einiges mehr möglichkeiten.

Hier sowas zb.: https://www.youtube.com/watch?v=3sVSQ_T2dR4

© 3D-Ring - deutsche 3D Software Community, Archiv 2001 - 2006